揭秘AI换脸骗术

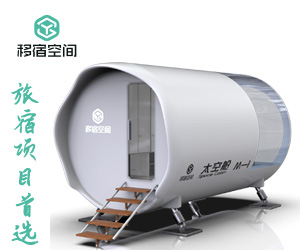

图:散播恐慌造市

1.筛选目标

•骗子首先分析公众发布在网上的信息,根据所要实施的骗术,通过AI技术筛选目标人群

2.截取声画

•骗子通过盗号或社交平台公开的相片、视频等提取冒充对象的声音、人脸素材

3.网聊欺诈

•骗子利用素材合成声音、AI换脸,在视频通话中利用假声假脸骗取信任,实施骗局

多地AI诈骗案例

冒充友人诈骗

近期,包头市公安局电信网络犯罪侦查局发布一起AI电信诈骗案,不法分子利用AI换脸、合成声音,以视频通话冒充被害人亲友联系被害人,博取被害人信任后实施诈骗。

不雅视频勒索

2021年,浙江温州公安曾发布消息称,受害人小陈在与女网友视频聊天后,被对方利用AI换脸技术,将小陈视频中的面部合成到不雅视频中,借此对其实施勒索。

散播恐慌造市

5月22日,一张由AI生成的五角大楼附近地区发生爆炸的图片(上图)在社交网络上疯传,推文称五角大楼附近地区发生了爆炸,造成金融市场恐慌,美股一度下挫,金价和美债攀升。

偷声音盗存款

最近英国一位能源公司CEO在不知情的情况下被骗子以AI合成了他的声音,并用这段声音电话转账了22万英镑到骗子自己在匈牙利的账户,后来本人才发现这宗骗局。

大公报记者张宝峰整理